对话它石智航丁文超:不VLA、不仿真、不遥操,它石智航的具身大脑没有Plan B

专属客服号

微信订阅号

大数据治理

全面提升数据价值

赋能业务提质增效

2026年3月,它石智航在AWE完成线下首秀,全球首个“能干活”的通用具身大模型AWE3.0也同期发布。

值此之际,时隔一年量子位再次深度对话它石智航。

以下为报道原文:

天使轮拿下

2.42亿美元

后,

它石智航到底干啥去了?

2025年年初,这家公司是资本市场毫无疑问的宠儿。天使轮融资额刷新纪录,明星创始团队,让它石自创立之初,便一跃成为具身智能赛道炙手可热的名字。

然而接下来的一年里,它石智航选择了一条截然不同的路:没有参加各种行业大会,没有频繁对外发声,

没有出现在春晚或各类展示活动中

,一直踏实干活。

一年后,这家以技术工程和产业落地集结的明星团队,交出了答卷

——

利刃出鞘,一鸣惊人。

它石

A1

机器人

,1小时内完成亚毫米级柔性线束完整装配任务百余次,创下全新吉尼斯世界纪录。

一系列成果让它石首次在线下亮相,便吸引了

央视、新华网

等头部官媒的组团报道。

线束装配

,是地狱级的工业场景。

长程操作、柔性操作、亚毫米精度,

不可能三角全部集齐

,被喻为工业自动化界的「哥德巴赫猜想」。

时隔一年,高调亮相的它石,直接打爆了这个场景,如期兑现了对投资人的承诺。

而同样是时隔一年,

量子位也再次来到了上海

——

从它石智航联合创始人、首席科学家

丁文超

这里,获得了关于这家公司更多的技术进展和背后的具身洞察。

真干活的具身大脑

当圈内还在争论机器人何时能真正干活时,它石智航已用硬核技术,交出了答卷。

专攻干活,而且要干就干最难的。这是它石从创立之初就确立的技术路线。

它石为

A1机器人选择的挑战,叫作亚毫米级线束装配任务。

这是具身智能最凶险的试金石。

首先是

精度

。

线束的孔位极小,

容错空间几乎为零

。

机器稍有偏差,插不进去;力道稍大也不行,会损坏插接孔位。

其次,

线是软的

。

这和玻璃杯不一样,你一碰,

线会变形

。

因此,模型每走一步,面对的都是一个和上一秒截然不同的物理世界,传统预先设计好轨迹的模式,在这里完全失灵。

而就是这样难度的任务,

还不是插接一根就能完事

。

线束少则十几根,多则几十根,每一根的插接状态都会影响下一根的空间和角度。

丁文超把这类任务概括为具身智能的不可能三角。传统工业自动化精度高但柔性弱,具身方案能做长程任务但精度差。

想要三者同时兼顾,难如登天。

而如今,它石不仅经受住了这一考验,还将其彻底打穿,装配效率创下吉尼斯世界纪录。

甚至

还保留了极高的「活人味」。

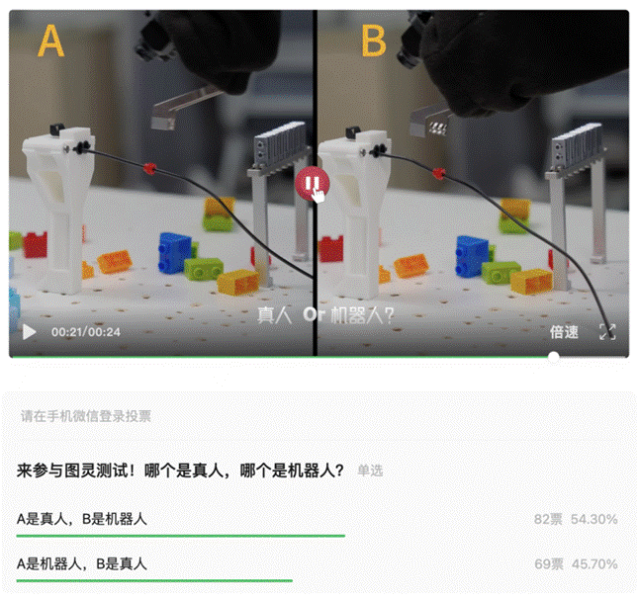

在他们发布的一次线束装配「图灵测试」中,

超过

50%的投票者

都分不清到底哪个才是机器人,误把选项

A认作真人。

既能干活,又保证了动作的丝滑程度,这就是它石潜心钻研一年所打造的具身大脑

——

AWE 3.0。

这个名字,有两处值得细细琢磨。

第一,

AWE,全称AI World Engine,

AI世界引擎

。

不是

VLA,也不是3D资产生成模型,而是一个真正意义上,能够作为具身大脑的世界模型。

依托超十万小时

Human Centric数据训练。

第二,

3.0,对标GPT-3

。

采访中,丁文超拿

GPT的发展脉络来做参照。

GPT-3做了两件事:把聊天场景打磨到极致,同时指明了这条Scaling曲线的走向。GPT-3出现之后,已经没人再怀疑LLM这条路。只不过GPT-3.5把它彻底引爆了。

AWE 3.0想做的,是同一个逻辑。

用线束装配对标聊天场景,把它打爆,同时验证模型在其他干活任务中的泛化能力。

丁文超坦言,做之前就清楚这是块硬骨头,但真正上手才发现,还是低估了难度。用传统方法,几乎不可能完成。

但也正是这座珠穆朗玛峰般的里程碑,催生出突破,最终汇聚成

AWE 3.0。

这个世界模型最核心的特点,叫

隐空间

。

关键在于「隐」这个字。这是一个经过压缩和抽象的中间世界,肉眼无法直接看到,对于具身智能来说却是更本质的学习环境。

面对柔性操作中层出不穷的突发状况,模型不再简单模仿动作轨迹,而是在隐空间里持续推演未来的多种可能,再据此做出决策。

这和

GPT-o1有几分相似:

在正式输出答案之前,先在思维链里推理一遍。

丁文超把这个过程叫作「未动先想」。

这当然能提高整个系统的鲁棒性,但出乎意料的是,在隐空间里思考的过程中,模型竟然涌现出一项全新的技能:自我纠错(

Failure Recovery)。

当插接力度或角度出现异常,机器人会把线拔出来,换个角度再试一次。

对于真实工业场景而言,这是一个象征着成熟度的关键信号:

机器人会反思了

。

不再需要人手把手教,即便遇到超出训练范围的场景,机器人也能自己在尝试中找到解法。

而这一切的实现,没有用到一秒钟的遥操数据。

全部是基于真人在真实场景中的实际操作,人类和机器人共享同一套感知体系。

长期以来,关于具身训练数据,行业有个共识:

遥操数据精度最高

。

丁文超却说,在亚毫米级精度的任务上,这个结论完全站不住脚。

遥操作根本干不了亚毫米级的事,操作过程中会犹豫、抖动,反而变成了训练数据中的「噪声」。

的确,线束这个场景,要求太恐怖了。孔位极窄,对丝滑度的要求非常高。

但人能完成这个任务。

虽然不能百分百零偏差,但人的纠错能力极强,可以在操作中感受阻力,并据此迅速调整角度和力度。

从第一性原理出发,丁文超指出,想要习得这种局部微调的能力,唯一方式,就是从真人身上采集数据。

这也是他在去年采访中反复强调的

Human Centric

。

一年过去,这一理念没有发生变化,并且已经成功落地。

这就是它石今年的第二项成果,

SenseHub数采套件

。

这是一套

以人为中心的一体化数采套件

。

非常轻便,一双手套,一个能够固定在胸部或头部的第一视角摄像头,完全无需像遥操那样进行专业培训,哪怕是清洁工、超市员工,佩戴上就能成为采集员,也不会影响工作。劳动者在日常工作过程中,顺手就能把数据采了,完全是

“被动式”采集。

与此同时,它石发起

具身数据星火计划

,邀请生态伙伴加入,基于

Human Centric推进具身数据标准建设、共建Human Centric数据集,构建产业级数据共享生态。该计划初期将汇聚超过1000万小时的标准化优质数据,目标推动实现

1亿小时级别的数据共享

。

2026年,Human Centric正在从它石率先验证的技术路线,快速演变为整个行业的共识。

具身智能的数据

Scaling,

这才刚刚拉开帷幕。

采访结束,已是夜里十一点,其中一间小会议室里,董事长李震宇和

CEO陈亦伦也在热烈讨论。

寒暄中,李震宇说这是创业后的常态。陈亦伦则幽默补充:

一般这个点才刚开始,具身智能的征程,往往越聊越兴奋。

刚刚亮相的技术和成果,无疑是它石智航「日新月异」的新起点。而负责技术研发推进的

丁文超

,给出了更多细节和实践认知。

对话原文

:

具身智能的

“准Zero-shot时代”已然来临

量子位:

A1刷新线束装配吉尼斯世界纪录令人印象深刻,研发过程中有什么挑战?哪些环节比预想的要难?

丁文超:

硬件远比我们想象的要重要。

你可以把它理解成

两头往中间靠

的过程:

一方面,通过合理的数据组织、网络训练、网络架构和任务设计,让模型能

人机通吃

;

另一方面,机器人自身也得往人的方向去靠,

自由度、灵活度,还有响应的及时性。

最开始我们采购了很多市售关节回来测,结果发现,要么响应延时有问题,要么扭矩脉动太大。这些都会导致机器人没办法像人一样灵活。

于是我们做了一个决定:

从

5月份开始,全栈硬件自研。

核心是两块。

第一是

关节完全自己做

,非常低的减速比、高精度、

GAP极小的行星关节,这在市面上非常少见。

第二是

灵巧手

。很多手套数据用夹爪去映射,信息损失太大。所以我们在去年开始研发

21自由度灵巧手,和人手完全匹配。

原本我们觉得,具身领域做硬件的公司那么多,产业链应该是成熟的。结果发现这个行业跟汽车工业相比,差距太大了。

品控、标准化、流程化,很多地方还处在

草台班子的状态

。

量子位:有没有什么是以前觉得很难,但实际下来,相对比自己预期、认知要容易一些的?

丁文超:

我觉得有三方面。

第一个,刚才讲过了,

跨本体映射其实没想象中那么难

。

这对业界是个反常识。直到今天,很多人还觉得人到机器人的跨本体映射是个大问题,但我们解决得还不错。

第二,

端到端网络到底能做到什么精度?

之前我们心里的答案是毫米级,但最近有了新突破,我们能做到亚毫米级。

这也是个反常识。大家一直觉得端到端网络特别依赖数据驱动,精度上是不是不如传统方法?事实证明不是。

还有第三点,

以人为中心的生态扩展,比我预想的快得多

。

现在各家在追这种采集方式,投入都特别大。很多人在深入研究我们的数据采集套件。

本以为大家转弯还需要时间。没想到

2026年,已经快成为以人为中心的数据采集元年了。

量子位:亚毫米级这个目标,是你们在实践中发现可以做到,还是场景本身倒逼出来的?

丁文超:

两者都有,但

倒逼的成分很大

。

线束插接场景本身就需要达到亚毫米级精度,逼着我们去想怎么让网络动作更连续、更丝滑,怎么实现

failure recovery,插错了也能局部微调重试。

这些能力,

如果我们一开始选的是叠毛巾,可能永远不会被逼出来

。

量子位:

那现在已经实现了亚毫米级操作,如果让模型去叠毛巾,需要重新学习吗?

丁文超:

真正的泛化,不只是模型本身的泛化,

数据和模型的覆盖范围也要泛化

。

对外聚焦线束,是因为我们想

先把这个场景彻底打穿

。但其实从第一天起,我们就同步在工厂、物流、仓储、洗衣房、酒店等

多个场景

采集数据,全部用于训练。

那时很多投资人还有所保留,觉得把一个场景做深、完成商业化就够了。但我们的判断是:

方法论层面的过拟合才是最致命的

,模型的过拟合反而相对容易消解。

现在我们内部已经有

N个可落地场景在并发推进,节奏比我自己预期的还要快。

量子位:具身智能的

GPT时刻,怎么定义?

丁文超:

去年聊这个词的时候,大家还定义不清楚。现在我可以给一个更具体的描述:

准

Zero-shot时代

。

不是说推到一个新场景完全零基础就能上,而是你已有的核心

skills,在新场景里基本都能迁移、都能用。

对标语言模型,大概相当于

GPT-3

的水平;如果某些任务彻底打穿,可能就到

GPT-3.5

了。

这个时间点比大家预想的早,说实话,也比我自己的预期快。我们规划的模型节奏是

2.0、3.0、3.5、4.0

,但我现在判断

3.5到4.0这段还会进一步加速。

两个趋势已经肉眼可见:

一是泛化数据的持续积累,二是有限数据下模型能力的快速提升。

一旦准

Zero-shot成立,机器人就不只能进工厂、做一个工序,而是可能同时覆盖多个工序。C端机会也会更早涌现。

量子位:

AWE 2.0意味着什么?

丁文超:

1.0是内部版本。2.0我们有点参考GPT-2的意味。

GPT-2代表

早期

Scaling Law成立

,并且在一些任务上已经能盖过

Bert这类小模型。对我们来说,2.0意味着我们真正完成了跨本体部署,从Human Centric数据到模型训练,再到机器人上的部署,这条链路跑通了。

3.0则不仅能够看到线束场景打穿,还看到了其他若干场景的涌现;

3.5是我们在其中几个场景彻底打爆。

4.0就是去年跟大家讲的世界引擎。为什么要同时预测环境和动作?最终是为了服务强化学习。模型充当自己的仿真器,自己预测环境、预测动作,做长程思考、高并发多场景并发推演。

量子位:

AWE 3.0类比GPT系列的话,3.0相当于什么阶段?

丁文超:

GPT-3出来之后,已经没有人怀疑这条路能不能走通,只是3.5才把它彻底引爆到终端用户。

我们现在也处于类似的位置。

AWE 3.0出来,加上接下来会发布的泛化任务,大家应该不再怀疑具身还会有Scaling的瓶颈,不再怀疑泛化能不能实现。

GPT-3最大的贡献,就是

把这条

Scaling曲线的方向指明了

。春江水暖鸭先知,真正关注

GPT-3的人,那时候就已经开始投身大模型创业。

具身现在也到了这个时刻。

量子位:

3.0出来之后,有没有做同行评测或benchmark跑分?

丁文超:

具身的

benchmark现在说实话比较混乱,非常像早期的自动驾驶。

各家都说自己最牛,学术榜单持续存在,八仙过海各显神通,每家都曾经拿过某个榜单的第一。但后来大家发现,榜单的第一第二根本没意义。

具身现在正处于从第一阶段迈向第二阶段的节点。第一阶段就是现在,大家在吹各种

benchmark,但你仔细深挖评测指标和评测环境,会发现偏差非常严重。

我们内部有自己的

benchmark体系,用in-house数据集和公开数据集,跟业界各个SOTA模型对比,包括闭环实验。

从我们内部的横向比较看,现在能公开接触的模型,距离真正能干活的通用模型还有非常远的距离。

随着具身从垂直场景走向多场景、走向更

C端,横评时代很快就会来临。

量子位:具身智能的

Scaling Law,好像跟当年GPT引发的风潮不太一样。GPT时代越做越大,但具身领域却出现了做得更小更精的方向,你怎么看?

丁文超:

Scaling Law要拆成三个阶段:

数据

Scaling、参数Scaling,以及推理Scaling

。

对具身来说,

数据

Scaling Law的红利远远还没吃完

。

现在大家觉得具身模型的方差比较大,小模型有时候反而好,大模型反而差,根本原因是第一波红利没吃完。

数据

Scaling没做扎实的时候,模型Scaling就处于一种不稳固的状态,很容易掉进局部最优,导致各种noise和方差。

但只要把数据

Scaling做得足够扎实,

大模型能力强于小模型

,这是毫无疑问的。

如果

2026、2027年大家解决了数据Scaling Law的问题,大家一定会想方设法扩张模型。

量子位:那如今数据

Scaling Law的瓶颈在哪?

丁文超:

最大的问题是量级。

遥操作有一个致命问题:它不会激励你去解决跨本体的问题。硬件一升级,之前的遥操作数据不能复用。所以想靠遥操达到千万小时级别,根本不可能。

真正的钥匙,是

Human Centric

。

我们内部的数据量确实涨得很快,我们也发起了星火联盟数据生态计划,让更多人参与进来一起迭代。

现在我们在冲刺的目标就是千万小时级别,我们想要的收益,就是把模型推到一个新任务、新地方,能以准专业的状态把任务基本完成。

量子位:所以数据

Scaling Law没有兑现,也就证明了仿真合成数据、遥操作数据这条路走不通?

丁文超:

是的,我非常有信心表达这个观点。

今天我可以直接告诉大家:

真实场景里无处不在的

Human Centric数据,一定会带来第一波巨大的数据红利。

全球首个能干活的具身超级大脑

AWE3.0诞生

量子位:

AWE 3.0这个模型,参数量和主要特点是什么?

丁文超:

第一,模型

size和数据量之间有一个对应关系。

30B能吸收接近百万小时,100B以上才能吸收千万小时级别

。

数据节奏、模型节奏,两者必须齐头并进。

第二,这个模型应该是目前市面上推理速度最快的同规模模型,通过隐空间内异步动作输出的方式,

输出效率可以做到十倍以上

。

这一点非常反常识。大家以前觉得要实现丝滑运行,必须靠大小脑双系统,大脑低频推理,小脑高频执行,两者割裂配合。

但我们是一个模型,桥梁是隐空间里的隐变量。

量子位:隐空间内的动作输出,是一开始就设计好的,还是实践中摸索出来的?

丁文超:

完全是实践中的认知。

最初我们只是想到模型要同时预测环境和动作,但线束任务对丝滑度的要求极高,倒逼我们去想:

模型这么大,怎么还能做到这么流畅?

从第一性原理看,双系统大小脑本质上还是两个不相干的东西凑在一起。我们还是想在统一的模型架构里解决这个问题,最终就催生了在隐空间这条路。

量子位:去年聊的时候还没那么笃定要

all-in-one,现在已经是确定的方向了?

丁文超:

把所有东西集成在一个模型里,肯定是大趋势。大小脑的融合也是必然方向。

我甚至觉得,具身领域将来会涌现出自己的原生基础模型。

你看现在业界所有模型,

本质上都是外来户

。

VLA是把VLM搬过来加一个action头;world action model、video action model是把

视频

预测模型搬过来,再拼一个动作输出。

这些

“外来和尚”在具身领域遇到的问题都很类似。

VLA的问题是泛化

,到一个新场景,

action需要大量新场景数据才能变好。

video action model大家现在讨论得还不多,但我可以预告一下:第一,

视频

预测的幻觉会影响动作质量

;第二,

视频预测很难维护精细的空间结构

,导致模型最终还是在记动作。

原生模型可以完全避开这两个问题。我们所有数据天然就是视觉、语言、动作三种模态对齐的,训练时可以在任意模态之间互相转换。

vision to vision是视频预测,vision+language to action是端到端,vision+language to vision+action就是世界模型。

现有的所有范式,在这套框架下得到了大一统,也没有

VLM强行加action head带来的那种割裂感。

量子位:你说

VLM、video action model会遇到这些问题,是思想实验,还是你们真的踩过坑?

丁文超:

两者结合。

第一,我从第一性原理判断它必然会有这些问题。

第二,我们有一个不小的

research team,会持续跟踪业界所有SOTA方法,包括VLA、视频动作模型、世界动作模型,全部纳入我们自己的benchmark。

我们每发一版模型,都会在

N个任务上跟现有SOTA做比较。

另外我想补充一点:

谈原生模型,前提是你有没有足够的数据

。原生模型玩的就是数据,追求的是三种模态完美对齐。

量子位:当前的模型规模,是数据量决定了它,还是先定了规模再去配数据?

丁文超:

是在实操中摸出来的。我们的数据量和模型规模都是一点点往上涨,慢慢发现数据涨到一定规模,模型

size就需要提升到下一个level才能继续吸收。

这个对应关系,是从自动驾驶时代积累的经验,加上具身这边数据量快速增长的实践,综合感受出来的。

量子位:你们内部评价模型好坏的标准是什么?

丁文超:

三个维度。

第一是

成功率

,这是一切的基准。

第二是

完成效率

,因为我们第一个场景是要真正落地工厂的。

第三是

类人性

,赏心悦目也是指标。

有意思的是,我们在线束插接这个子任务上,效率已经超过人了。

这里面有个

trick:人没法左手画圆右手画方,但机器人可以,通过对数据合理的组织,我们

让机器人做到了双手并行

,这样自然就比人快。

量子位:类人性这个维度很有意思,你加这个指标是为了让动作更丝滑,还是有更深的考量?

丁文超:

第一性原理上,你追求丝滑,追求看起来像人,最终都是为了让机器人真正进入人类社会。

去年你也问过我机器人最终的形态会是什么,我当时说

拟人形是大趋势

。

哪怕在垂直场景有特制形态,完成动作的方式也应该贴近人,这种

亲和性是人类社会的一种刚需

。

你看现在

大家为什么喜欢看机器人跳舞?

因为它给人的感觉像自己。

展会上我们的双足机器人只要出来,现场就围得人山人海。

哪怕是从货架上抓一个水瓶,这个动作可以很机械,也可以很丝滑,给人的感官完全不同,人想要使用它、信赖它的欲望也完全不同。

所以类人性这个指标,一方面是在评价模型能力,另一方面,

对于人和机器人将来真正共生

,也是非常关键的一点。

量子位:训练成本对一家创业公司来说,压力大吗?

丁文超:好钢用在刀刃上

。我们没有一口气铺几千张卡漫无目的地训,而是随着数据量上升,看到模型吃不住了再加参数,每一个实验都仔细评估价值。

我们的

目标是打经济仗,在有限投入下拿最大

ROI

。

具身的

生命周期可能比自动驾驶还要长

,上面可能有若干次决战,所以弹药和粮草必须存够,每一次决战都要有主动出击的能力。

支撑具身智能的基石,超级数据范式

Human Centric

量子位:数据质量的把控,你们是怎么做的?

丁文超:

这件事比很多人想象的要难得多。

Human Centric意味着采集主体是人,不像设备那么可控。我们早期就遇到过,现场工作人员被动式采集,

结果在现场玩了

15分钟手机

。

后来,我们在采前、采中做了工作。

采前是

约法三章,现场培训

,明确哪些行为不允许。

采中是在

APP上做监测,检测到异常状态就报警

。

这样基本上能把八九成的问题筛掉,后端数据产线的利用率会非常高。

量子位:

AWE 3.0的训练数据,全部是Human Centric采集的吗?还是有一些配比?

丁文超:

这里有个反常识的结论。

大家一直认为遥操作数据精度最高,

Human Centric数据精度上是短板。但在亚毫米级任务上,

结论完全相反

。

遥操作根本干不了亚毫米级的事,操作过程中会犹豫、抖动,反而变成了噪声。我们亚毫米级的模型,完全是用

Human Centric数据训练的。

随着我们把更多场景扩展开,靠

Human Centric数据支撑整个模型训练到部署,完全可以做到。

量子位:所以后续模型迭代,核心就是数据量级的持续扩展?

丁文超:

对,以前大家总想着数据有一座金字塔,高质量数据、中等数据、大规模数据各种配比,搞得很复杂。

但我觉得未来可能根本没有什么数据金字塔。你把一种数据打磨到极致,把所有细节做好,质量可能比配比来的数据要高。

量子位:那为什么此前行业里会形成数据金字塔这样的共识?

丁文超:

任何一个细节没做好,都会给你带来错误的结论。

Human Centric数据要做到亚毫米级精度,

门槛极高

。

佩戴在人身上,要把动作完整恢复出来,

传感器同步、标定、云端自动化标注算法

,每一个环节都不能出问题。

现在业界大多都还没搞清楚怎么把

Human Centric数据做到很高精度,更不用谈后面部署到机器人上完成闭环任务。

量子位:遥操作数据的成本应该比

Human Centric低吧?

丁文超:恰恰相反

,遥操作数据的成本远高于

Human Centric。

你算一下遥操作的成本:得买一台机器人,得有数采中心或者把机器人推到现场,还得有专业遥操员。

遥操员这个行业现在慢慢兴起,但

流失率很高,工作枯燥

,培训一个新遥操员又要一两个月。

Human Centric完全不同。

采集者可以是清洁阿姨、超市工作人员。他们戴上数采手套就能在日常工作中顺带完成数据采集。

量子位:你们选择了开放这个生态,如果有更大体量的玩家来怼数据,会削弱你们的护城河吗?

丁文超:

正确的方法论,别人终究会挤进来。与其守住硬件设备,不如把门槛真正建立在

AI上。

就像大模型训练一样,大家都知道怎么训,但最终训出来的模型差异还是会体现出来,这就是不传之秘。

量子位:线束这个模型,大概学习了多久?

丁文超:

与其说训练了多久,不如说是随着数据量级持续提升的一个过程。

大概时间线是这样:

AWE 2.0从去年年中开始,那时候Human Centric的采集、训练、部署已经走通了。

从

AWE 2.0到AWE 3.0明显加快了,数据运转更顺,模型上也有很多新感觉涌现出来,年后没多久就在3月发布了AWE 3.0。

这也是为什么我判断后面节奏会进一步加速,随着数据量越来越大、模型越来越成熟,智能涌现的时间也会缩短。

量子位:

Sergey那篇关于叉勺(Spork)的博客你看了是什么感受?

丁文超:

有些观点我同意。

仿真数据没用。

Sergey自己也采了几千小时数据,是真正走过这个过程的人,他知道机器人部署到真实世界需要多少数据、怎么才能泛化。

他说仿真是叉勺,勺子能喝汤、叉子能插牛排,但集成为叉勺,

又什么都干不好

,这个比喻我觉得很恰当。

分歧在于:

有了真实数据之后,怎么高效利用?

他的路径是遥操作获取基础数据,加上大规模真机强化学习,我对这条路是有疑问的。

所以答案就是,大的方向上有共鸣:

真实世界的数据才是走向泛化的金钥匙。

但怎么把数据闭环鲁棒性提升、真正走向规模化商业落地,路径是不同的。

量子位:这种路径差异,会不会有中国与硅谷环境不同的原因?中国有更丰富的人力资源,所以可以做

Human Centric采集。

丁文超:

有这个因素,但不是全部原因。

早期

Generalist这类公司还在宣传几十万小时数据,现在有些硅谷公司开始说我只需要10小时、20小时数据就够了。26、27年这个分歧会越来越明显。

但让我比较惊讶的是

Generalist,作为在硅谷的公司同样坚定走Human Centric路线,而且scale在10万小时级别以上。所以环境不是决定性因素,更深层的原因可能是惯性。

量子位:达到什么样的数据量级,才能支撑到你们说的

4.0水平?

丁文超:

具身比自驾复杂得多,本体自由度更高,是复杂

3D环境,还有大量密集的contact操作,场景丰富度也更高。根据我们现在的实践经验,具身所需的数据量至少是自动驾驶数据量级的10倍。

具身可能有三个坎:

10万小时是模型能力不错;100万小时是准产品级,可以deliver给各种用户;1000万小时之后,数据Scaling law的讨论会变少,大家开始讨论模型架构,前沿公司开始做强化学习。

量子位:具身的数据采集比自动驾驶复杂得多,你们怎么保证采集质量和覆盖度?

丁文超:

我们有一套自动化调度系统,每天汇总返回来的数据,

check场景覆盖了哪些、任务做了哪些、动作pattern的分布,然后第二天针对性补缺,再去采。

这套系统保证我们不会偏科,不会在一个场景过度采集,那样重复度太高,变成同质化数据,不是有效的

scale。

量子位:采集过程中有没有让你意外的地方?

丁文超:

人的行为实在太丰富了。越采集,越对人的行为产生敬畏。

遥操作相当于带着义肢去操作

,很多人的本能行为在那个状态下都会变形。但如果直接从人身上采,你会发现人很多日常动作里藏着大量自己都没意识到的操作智慧。

最让我印象深的是

failure recovery。

人的精度并不是绝对的

,移了

1厘米还是1.5厘米其实自己不一定知道。但人的局部微调能力极强,出了问题能自然地调整修正。

这也是为什么我们一定要把人的行为原原本本全量记录,所以我们做了

五指采集手套

;执行器也必须能原原本本还原人的行为,所以要做

21自由度灵巧手

。

超级本体,为

AI而生

量子位:手套和灵巧手之间是什么关系?

丁文超:

完全镜像。手套捕捉人手的完整自由度,有两个核心优势:

一是能采集末端触觉,二是无惧遮挡。

用

VR眼镜采集,

手一挡就丢失数据

。手套不存在这个问题。

灵巧手这边,人手大概

20到21个自由度,做到这个数字基本就能描绘人手所有运动,这就是为什么大家都在追求20自由度以上。

我举个例子。我们展示的刺绣任务里有个顶针动作,夹爪很难做。缝纫工人为什么戴扳指?就是为了捏住针之后用指头把它顶过去。

夹爪只能夹,没法顶,所以用夹爪做刺绣就要绕很多弯路。这就是手的价值。

量子位:灵巧手研发难度怎么样?

丁文超:

挺有挑战的。在这么小的空间内实现这么高的自由度,技术路径本身就有争议,准直驱还是绳驱,电机设计、减速器设计

……都是一点点摸索出来的。

线束场景倒逼我们把

Human Centric逼到亚毫米级,而灵巧手,倒逼我们把电机和减速器的设计制造能力逼到极限。

我们应该是目前世界上屈指可数可以做到准直驱、高自由度、还能集成到人手尺寸的公司。今年

ICRA

(机器人国际顶会)我们会对外展示。

量子位:灵巧手解决之后,会解锁哪些场景?

丁文超:

线束场景里我们现在用夹爪完成的工序大概覆盖

70%的任务,剩下的比如缠胶、理线,手会方便很多。

如果真的想做通用工业解决方案,绕不开灵巧手。

量子位:为什么机器人手都做五根手指,不做六根七根?

丁文超:

六根手指,数据就对不上了。你从人身上采不到六指数据,还得自己造数据,

边际效应马上就显现

。

所以机器人手的自由度大概率是小于等于人手,这样才能最大化利用

Human Centric数据。

量子位:手的终极目标是什么?

丁文超:

人手能做的任何动作,灵巧手都能做出来。全身人形其实现在已经基本可以做到动作模仿,手也在朝这个目标走。剩下的问题就是手脑协同。

量子位:你们有

A和T两个系列,各自的优势是什么?

丁文超:

T是双足,A是轮式双臂。

本体层面,各家整机设计现在其实收敛了,差异没那么大。我们比较有特色的是关节。

以前大家设计关节,电机扭矩、减速比都是越大越好。但我们发现本质上是一个

distribution match(分布匹配)的过程:

你要让机器人执行动作的空间和流畅度,尽可能贴近人的数据分布。

把这个目标拆解,整机构型大家都差不多是拟人型,真正关键的就是关节,包括末端灵巧手关节到核心关节。

机器人本体你可以理解成以关节为核心的一堆连接件,关节才是一切。

遥操作会天然把你降速

,你感受不到机器人还需要变得更好。

但一旦你采集的是人的数据,你就会永远想让机器人去匹配人的动作分布,这个驱动力就会持续逼着你把关节做得更好。

量子位:本体为

AI而生,怎么理解?

丁文超:

传统的本体设计是正向的,关节要出多大扭矩、减速比定多少,凭感觉来。

为

AI而生是反向推导。我们采集了大量人的数据,知道人在完成各种任务时末端需要多大力度、多快速度,这形成了一个distribution A。

我们设计本体,就是让机器人的工作空间、力输出、运动速度形成的

distribution B,尽可能去匹配distribution A。这样AI模型在上面适配,迁移会更顺滑。

这本质上是个双向奔赴的过程。一边是模型通过空间预训练、全身端到端、各种技巧让迁移更鲁棒;另一边是

硬件朝人靠拢

。两者同时收紧,中间的

gap才能消掉。

量子位:当初为什么选线束这么难的场景?

丁文超:

真正触动我们的,是亲眼在线束工厂看到的那一幕:密密麻麻全是人,

空气里弥漫着汗味

,工人非常忙碌。

我们也访谈了工人,他们自己干得很痛苦。插线的错误率大约是

千分之三,但只要一根线插错,整条线束就要重做。

工人

压力很大

,流失率极高,几个月就换一批人,管理成本也居高不下。

我们当时调研了很多场景,判断标准很简单:有

没有大量的人在干这件事?

线束完全符合,这是真需求。

第一步是从需求出发,第二步才分析这个任务有没有门槛,发现它兼具长程、柔性、高精度,确实很难。但我们对自己这个团队有信心,决定去磕它。

早期有很多人不看好,觉得太精细了。但毕竟之前没有人展示过具身能在这么精细的任务上持续稳定工作,有这个反应也很正常。

量子位:你们有没有

Plan B,一个比线束更容易的场景?

丁文超:

选了线束之后,我们

没有给自己想过退路

。

我觉得这一代具身智能的价值就在这儿:

解决柔性、长程、高精度三者兼具的问题。

任何不满足这三个特质的场景,传统自动化都能解决,不需要具身智能。你可以沿着这个逻辑去审视市面上各家具身的落地场景。

线束通了,其他场景是能力外溢的问题。成功率、精度、柔性外溢出去,很多装配场景虽然没有线束那么极端,但也有毫米级子动作、多工序要求,我们的能力是够用的。

量子位:批量化落地的核心挑战是什么?

丁文超:

大脑的量产。

以前

机器人公司

有量产经验的都集中在小脑,解决本体一致性、产线问题,这些路已经探得差不多了。

大脑的量产是新问题,不仅是硬件量产,还包括模型能力的量产。

比如硬件之间稍有差异,模型还得能泛化。还有一个更少人想过的问题:

生命周期内的泛化

。

机器人在客户现场用久了会有损耗,响应特性会变化,你的模型

随着机器状态的改变,还能不能稳定工作?

这个维度,现在很多人都还没考虑过。

量子位:你们做了数据、模型、本体、关节、灵巧手,每一块拆开都能做一家独角兽,你们怎么定位自己?

丁文超:

我们不是一家生态公司,初衷完全不同。

如果是为了做生态而做生态,你每一块都不会追求极致。但我们是真的想解决问题,还是第一性原理出发,这才驱动我们把每件事做到极限。

如果我们把自己定位成生态公司,我们没必要把减速比、自由度这些东西推到极致,能卖出去满足基本需求就行了。但这两种做法,差异性很大。

量子位:随着规模变大,你们怎么平衡敏捷和复杂度?

丁文超:

我对具身行业有个

3+3+3的判断。前三年是认知收敛期,现在到接下来三年是打硬仗期,

再往后三年是淘汰赛

。

现在这个阶段,技术路径逐渐收敛,会催生硬件平台的标准化。我们现在做关节、做手,某种程度上是在牵引这个标准的制定。

但这些标准在两三年内会慢慢固化,固化之后各个子部件会有更多能力外溢。

大厂下场也会加速这个过程

,他们的标准化经验会推动行业收敛更快。

当前最关键的还是两件事:

第一,在工厂里证明真的能干活;第二,对未来有想象力。

大脑时代开启,它石已让具身智能真干活

量子位:过去一年有什么让你兴奋的进展?

丁文超:

具身大脑上的竞争激烈度会上升得很快,这让我兴奋也让我警惕。

说实话,中国整体的大脑进展是

慢于硅谷的

。

中国最成熟的是本体和小脑,在大脑上有原创性创新的公司非常稀缺。

硅谷陆续涌现一些公司,不追求本体硬件能力,专注刷大脑,

Generalist

这类进展很快。

过去一年我们绝大多数精力都投入在大脑上,就是因为意识到大脑能力的决定性作用。

量子位:春晚上机器人那么热闹,你怎么看?

丁文超:

两点感受。

第一,友商的表现让我觉得,

本体和小脑的竞赛基本上已经结束了

。再给其他公司

6到12个月,大家都能达到类似水平。

虽然还有很多公司在往里冲,但问题已经收敛,只不过各家时间上滞后几个月而已。

第二,

大脑时代开始了

。这对行业是好事,因为人们一直低估了具身的行业价值。

以前大家的估值逻辑很粗,就是能卖多少台机器人。但一旦具身大脑真的能批量转换生产力,整个估值逻辑要重写。

我觉得大脑的引擎完全可以接住第二波增长,整体价值还会继续往上走。

3+3+3,淘汰赛最终还是会来。

量子位:你们希望外界给你们贴什么标签?

丁文超:

能干活的具身通用大脑。

具身的本质是把

AI赋予物理实体,让它在生产生活中发挥价值。我们想做的是智能程度高、有自主能力、能真正帮助人的大脑公司。

加上能干活这三个字,是因为现在

说自己是具身大脑公司的太多了

,得有个金标准。能不能稳定、可靠、高效地干活,就是这个金标准。

现在很多是披着干活外衣的表演,我们想和这类划清界限。

量子位:家庭机器人还有多远?

丁文超:

我觉得快的话有

可能小于

3年

,是因为我真实感知到了技术发展的加速,这个事情是会实现的。

量子位:物理

AI要达到现在信息AI那个水平,需要多少数据?

丁文超:

千万小时。

不是重复性的数据,是按场景和工序控制过多样性的千万小时。

量子位:遥操作数据重复性太高,这是行业里另一层泡沫吗?

丁文超:

对,遥操作深受其害。遥操作数据大部分来自数采中心,数据多样性

取决于数采中心的装修频率

,现在装修最快的也就一个月一次。

量子位:自由度军备竞赛,你们会卷吗?

丁文超:

自由度能匹配人就够了,不是越多越好。

躯干大概

20多个自由度,单手也是20多个,把机器人末端送到三维空间某个姿态,现在大多数机器人都具备这个能力。

真正的问题是末端到了之后,能不能灵巧地和物体交互完成任务。所以末端自由度才是关键,现在很多人在全身自由度上卷,有点舍本逐末。

量子位:你们从一开始就站世界模型这个方向,原因是什么?

丁文超:

是被

Human Centric逼出来的。

我当时在思考,什么样的模型才能吸收这么多

Human Centric数据?

单纯的动作模仿很难学到人运动的精髓,泛化性和跨环境迁移都很弱。我们测评了各种

VLA,发现过拟合太严重。

现在大家说世界模型,

定义本身还很模糊

。

很多人问我:

李飞飞那种算不算世界模型?

我觉得李飞飞推出的世界模型,更多是基于空间的维度做生成及渲染,而具身则需要落实到我们所处时空的具体动作上。

Marble只是对空间有预测能力

,但具身最终要落到动作上,这是很大的差异。即便对未来假想得很好,但动作很可能还是不行。

最新的学术工作中,虽然说指标上会有提升,但视频预测的幻觉影响动作这个问题,业界还没人去解决。

视频预测不等于世界模型,真正的世界模型必须最终回归到动作,而且要解决环境预测和三维空间内动作的一致性问题。

量子位:具身领域有没有类似信息

AI那样的AGI目标?

丁文超:

我最近也一直在思考这个问题。

现在有两种

AGI叙事。第一种是大水漫灌,模型能力慢慢提升,最后变成无所不能的通才。

但语言模型的实际形态告诉我们,它更像是个

天才国度

(

a country of genius),在若干个子任务上有峰值很高,但落到缝隙里其实也就普通人水平。

我实验下来的感觉,具身很可能也是这种形态,更像一片竹林,

竹子越来越多、越来越密

。但竹子之间的缝隙还是存在的,那些

低谷部分

,可能只能勉强达到人类水平,甚至略低。

有时我也会想,追求大水漫灌式的具身

AGI,

是不是我们未来十年的使命?

答案将留给实践和时间。